Die Diskussion um Künstliche Intelligenz ist allgegenwärtig – sie verspricht Fortschritt, wirft aber auch drängende ethische und regulatorische Fragen auf. OpenAI hat kürzlich seine neuen KI-Richtlinien vorgestellt, die das Verhalten von Modellen wie ChatGPT im Umgang mit kontroversen Themen neu definieren. Diese Änderungen sollen Transparenz erhöhen, Entwicklern mehr Anpassungsmöglichkeiten geben und eine objektivere Beantwortung sensibler Fragen ermöglichen.

Doch während OpenAI die Neuerungen als Fortschritt feiert, warnen Kritiker vor möglichen Gefahren wie einer problematischen Neutralität oder gar der Verbreitung von Desinformation. Dieser Artikel beleuchtet die wichtigsten Aspekte der neuen KI-Richtlinien von OpenAI, diskutiert Chancen und Risiken und gibt einen Überblick darüber, wie sich diese Veränderungen auf Nutzer, Unternehmen und Entwickler auswirken.

Welche Veränderungen bringen die neuen KI-Richtlinien von OpenAI?

Die neuen KI-Richtlinien von OpenAI, auch als „Model Spec“ bekannt, setzen klare Vorgaben für die Nutzung und das Verhalten von KI-Modellen. Zu den wichtigsten Änderungen gehören:

✅ Mehr Offenheit bei kontroversen Themen: Statt problematische Themen zu vermeiden, sollen KI-Modelle objektive und transparente Antworten liefern.

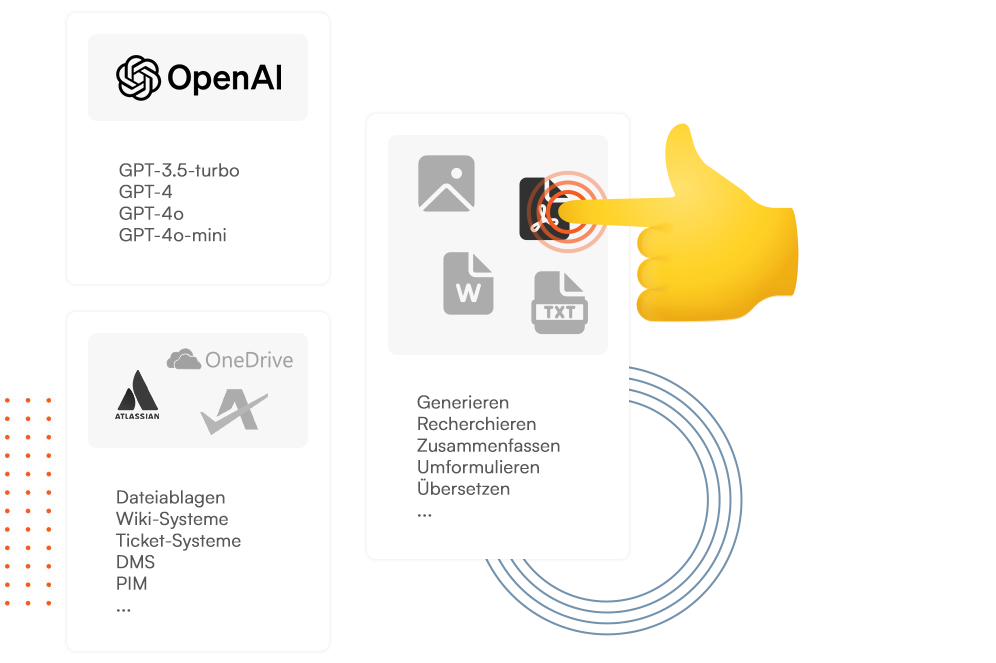

✅ Erweiterte Anpassungsmöglichkeiten für Entwickler: Unternehmen können KI-Verhalten besser anpassen, müssen aber ethische Standards einhalten.

✅ Transparenz und Dokumentation: Die neuen Regeln sind öffentlich einsehbar, um Vertrauen zu schaffen.

✅ Ethik und Sicherheit als zentrale Prinzipien: Missbrauch der KI bleibt weiterhin verboten.

Diese Änderungen zielen darauf ab, die Interaktion zwischen Nutzern und KI-Modellen zu verbessern und eine verantwortungsvolle Nutzung sicherzustellen. Doch nicht jeder sieht darin nur Vorteile.

Warum wurden die neuen KI-Richtlinien von OpenAI eingeführt?

Die Anpassung der neuen KI-Richtlinien von OpenAI ist eine Reaktion auf anhaltende Kritik. Nutzer und Experten hatten bemängelt, dass OpenAIs Modelle bei sensiblen Themen oft zu vorsichtig oder voreingenommen reagierten. Insbesondere wurden Antworten teilweise verweigert oder in eine bestimmte Richtung gelenkt. Mit den neuen Regeln soll eine bessere Balance zwischen Objektivität und ethischer Verantwortung gefunden werden. Kritische Themen sollen nicht mehr kategorisch vermieden, sondern mit einer neutralen Perspektive behandelt werden. Darüber hinaus steht OpenAI unter politischem Druck. Es gab Vorwürfe, dass die KI-Modelle eine einseitige politische Tendenz haben. Die neuen Richtlinien könnten darauf abzielen, diese Kritik zu entschärfen.

Kritik an den neuen KI-Richtlinien von OpenAI

Obwohl OpenAI die neuen Regeln als Fortschritt darstellt, gibt es erhebliche Bedenken:

1. Gefahr einer problematischen Neutralität

Ein Hauptkritikpunkt ist, dass durch die neue Neutralität problematische Inhalte wie wissenschaftlich widerlegte Theorien, extremistische Ansichten oder Fehlinformationen verstärkt werden könnten. Die KI könnte – in dem Bestreben, neutral zu bleiben – wissenschaftlich widerlegte Theorien gleichwertig mit fundierten Fakten darstellen.

📌 Beispiel

Früher: ChatGPT hätte Fehlinformationen zu Impfungen klar abgelehnt.

Jetzt: Das Modell könnte verschiedene Meinungen darstellen, ohne eindeutig darauf hinzuweisen, welche wissenschaftlich belegt ist.

2. Desinformation und Fake News

Wenn KI-Modelle zu sensiblen Themen nun eine breitere Palette an Antworten liefern, könnte dies ungewollt zur Verbreitung von Fehlinformationen beitragen. Ein Beispiel dafür sind historische oder politische Debatten, in denen manipulative Darstellungen als „alternative Perspektiven“ erscheinen könnten. Kritiker befürchten, dass dies dazu führen könnte, dass Nutzer falsche Informationen für glaubwürdig halten.

3. Politische Einflussnahme und wirtschaftliche Interessen

Ein weiterer kritischer Punkt ist, ob OpenAI sich durch diese Richtlinien politischen und wirtschaftlichen Interessen beugt. Einige Analysten vermuten, dass OpenAI mit den neuen Regeln einerseits politischem Druck nachgibt und andererseits wirtschaftliche Interessen verfolgt, um eine breitere Nutzerbasis zu erreichen.

Welche Auswirkungen haben die neuen KI-Richtlinien von OpenAI?

Die Auswirkungen der neuen Richtlinien betreffen verschiedene Gruppen unterschiedlich:

🧑💻 Für Entwickler:

- Mehr Möglichkeiten zur Individualisierung von KI-Modellen.

- Größere Verantwortung für ethische Nutzung.

- Potenzielle Gefahr, dass Nutzer ungewollt Desinformationen erhalten.

📢 Für Unternehmen:

- KI kann besser an Unternehmensbedürfnisse angepasst werden.

- Kundenservice-Chatbots und Informationssysteme können individualisiert werden.

- Risiko, dass Unternehmen ethische Standards zugunsten von wirtschaftlichen Interessen anpassen.

🗣️ Für Endnutzer:

- Mehr Kontext und Perspektiven in KI-Antworten.

- Mögliche Herausforderung, zwischen Fakten und Meinungen zu unterscheiden.

- Mehr Transparenz, aber auch mehr Verantwortung für Nutzer selbst.

Chance oder Risiko?

Die neuen KI-Richtlinien von OpenAI sind ein wichtiger Schritt in der Weiterentwicklung von KI-Modellen. Sie bringen mehr Offenheit, mehr Individualisierungsmöglichkeiten und mehr Transparenz. Gleichzeitig werfen sie ernsthafte Fragen auf:

- Kann KI wirklich neutral sein?

- Wie geht OpenAI mit potenzieller Desinformation um?

- Welchen Einfluss haben wirtschaftliche und politische Interessen?

Es bleibt abzuwarten, wie sich die neuen Richtlinien in der Praxis auswirken. OpenAI steht vor der Herausforderung, die richtige Balance zwischen intellektueller Freiheit und Verantwortung zu finden. Nutzer und Entwickler sollten die Entwicklung genau beobachten, um sicherzustellen, dass diese neuen Richtlinien einen echten Fortschritt darstellen – und keine Gefahr.

Maßgeschneidert!

Passgenaue KI-Lösungen!

Sprechen Sie mit uns kostenlos und unverbindlich über potenzielle Einsatzwecke für künstliche Intelligenz in Ihrem Unternehmen. Erfahren Sie, wie wir eine maßgeschneidert Lösung für Ihre spezifischen Use-Cases entwickeln.